পুলিশ কর্মকর্তার বক্তব্য বলে এআই জেনারেটেড ভিডিও প্রচার

বুম বাংলাদেশ দেখেছে, ভিডিওটি বাস্তব কোনো বক্তব্যের নয় বরং এআই প্রযুক্তিতে এটি তৈরি করা হয়েছে।

সামাজিক যোগাযোগ মাধ্যম ফেসবুকে একটি ভিডিও পোস্ট করা হয়েছে। ভিডিওতে দেখা যাচ্ছে, বাংলাদেশ পুলিশের পোশাক পরা এক কর্মকর্তা বলছেন, 'চাকরি চলে যেতে পারে তবু বলি একটা দল ক্ষমতায় যাওয়ার (জন্য) যা শুরু করছে তা আওয়ামীলীগের ১৭ বছরকেও হার মানাচ্ছে। ভোট না দিলে তারা নাকি মানুষকে জান নিয়ে ঘরে ফিরতে দিবেনা। এদের জাহেল বললেও কম হবে ' এরকম কয়েকটি পোস্ট দেখুন এখানে, এখানে ও এখানে।

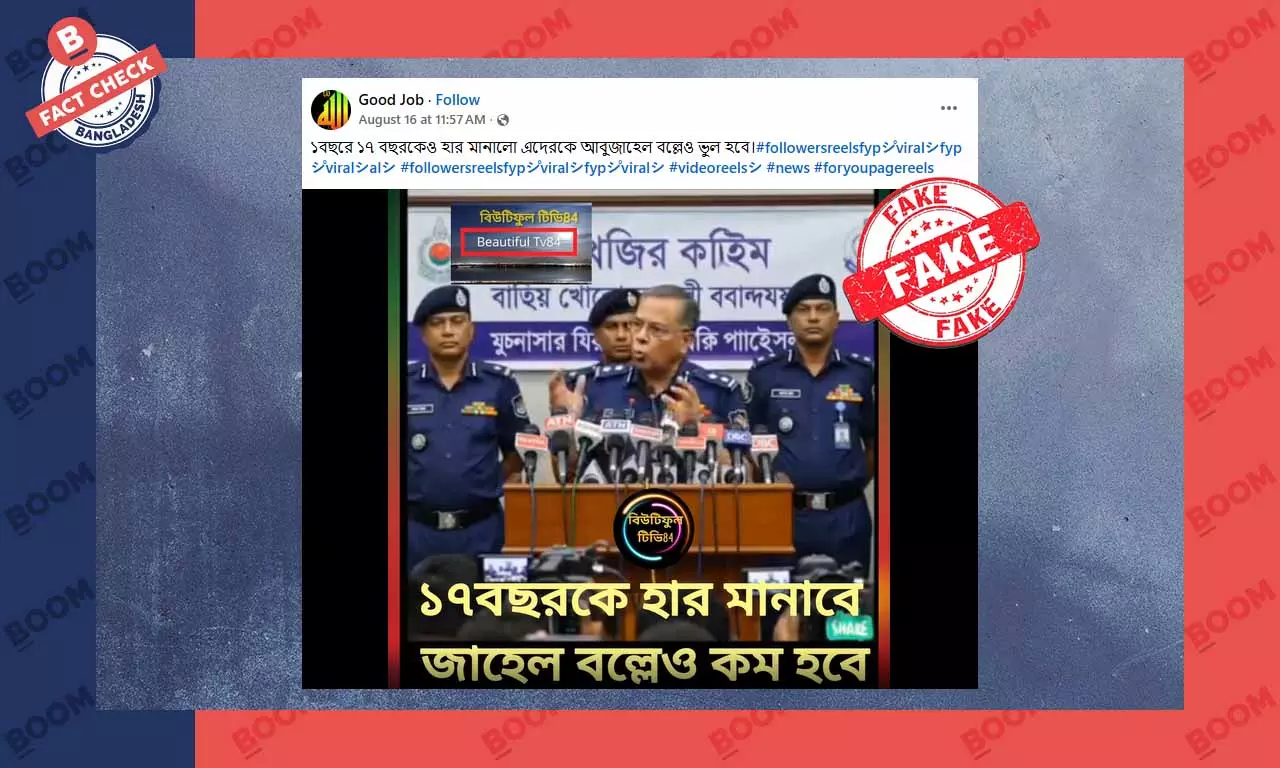

গত ১৬ আগস্ট ‘Good Job’ নামক একটি ফেসবুক অ্যাকাউন্ট থেকে ভিডিওটি পোস্ট করা হয়। পোস্টে উল্লেখ করা হয় "১ বছরে ১৭ বছরকেও হার মানালো এদেরকে আবুজাহেল বল্লেও ভুল হবে।" পোস্টটির স্ক্রিনশট দেখুন--

ফ্যাক্ট চেক:

বুম বাংলাদেশ যাচাই করে দেখেছে, দাবিটি সঠিক নয়। ভিডিওটি বাংলাদেশ পুলিশের কোনো কর্মকর্তার বক্তব্যের নয় বরং এআই প্রযুক্তিতে এটি তৈরি করা হয়েছে। অর্থাৎ এআই প্রযুক্তিতে তৈরি ভিডিওকে বাস্তবে দেওয়া বক্তব্যের বলে প্রচার করা হচ্ছে।

আলোচ্য ভিডিও থেকে কি-ফ্রেম নিয়ে সার্চ করে এবং ভিডিওতে প্রচারিত দাবি (বক্তব্য) সরাসরি সার্চ করে গণমাধ্যম সহ গ্রহণযোগ্য কোনো মাধ্যমে কোনো উল্লেখযোগ্য তথ্য পাওয়া যায়নি।

পরবর্তীতে ভিডিওটি পর্যবেক্ষণ করে বক্তার বক্তব্যে অসম্পূর্ণ বাক্য শোনা যায়। পাশাপাশি বক্তার সামনে রাখা সংবাদ মাধ্যমগুলোর ইন্টারভিউ মাইকের লোগোও পরিচিত কোনো সংবাদমাধ্যমের নয়। এছাড়াও, বক্তার পেছনের ব্যনারের টেক্সট দেখা যায় যা পাঠের অযোগ্য।

অধিকাংশ ক্ষেত্রে এআই তৈরি 'টেক্সট আর্টিফ্যাক্ট'-এর ক্ষেত্রে অক্ষর কেটে যাওয়া, অদ্ভুতভাবে ঘুরানো-উল্টানো বা মুছে যাওয়া, অক্ষরের অমিল ইত্যাদি 'টেক্সট ডিস্টর্শন' দেখা যায়। এই টেক্সট ডিস্টর্শনের ফলে এআই তৈরি ছবি-ভিডিওর লেখা প্রায়শই পাঠযোগ্য হয় না। দেখুন--

ভিডিওতে বাস্তব এমন দৃশ্যের অডিওর তুলনায় ভিডিওটিতে কথা বলার সাউন্ড কিছুটা অস্বাভাবিক মনে হয়েছে। সম্প্রতি সাধারণত গুগলের ভিও-৩ মডেল ব্যবহার করে তৈরি করা এআই ভিডিওতে অডিওর এমন উচ্চতর আউটপুট শোনা যায়।

গুগল 'Veo' হলো গুগলের একটি প্রায় বাস্তবসম্মত ভিডিও জেনারেশন টুল যা গুগল ডিপমাইন্ড দ্বারা তৈরি করা হয়েছে। এটি টেক্সট-টু-ভিডিও জেনারেশন, ইমেজ-টু-ভিডিও জেনারেশন এবং সর্বশেষ সংস্করণ, ভিও-৩ ভিডিওর পাশাপাশি নেটিভ অডিও তৈরি করতে পারে।

এছাড়াও গুগলের জেনারেটিভ টুল তাদের কন্টেন্টে 'SynthID' নামক এক ধরণের ওয়াটারমার্কিং ব্যবহার করে যা খালি চোখে দেখা না গেলেও গুগলের SynthID ডিটেকশন টুল সেটি শনাক্ত করতে পারে। এই প্রক্রিয়ায় যাচাই করলে টুলটি আলোচ্য ভিডিওর অডিওকে 'গুগলের এআই টুল দিয়ে তৈরি' বলে ফলাফল দিয়েছে। দেখুন--

অডিওতে 'SynthID' শনাক্ত করলেও টুলটি ভিডিওতে 'SynthID' ধরতে পারেনি। সাধারণত একটি ভিও-জেনারেটেড ভিডিওর কোয়ালিটি বিভিন্ন কারণে স্বাভাবিকের তুলনায় কম হয়ে গেলে কিংবা সম্পাদনার কারণে কম্প্রেস হলে অনেক ক্ষেত্রেই 'SynthID' ওয়াটারমার্ক শনাক্ত করা কঠিন হয়ে যায় কিংবা শনাক্ত হয়না।

আরেক এআই কন্টেন্ট শনাক্তকরণ টুল 'DeepFake-o-meter'-এর মাধ্যমে যাচাই করলেও টুলটি মিশ্র প্রতিক্রিয়াযুক্ত ফলাফল দিয়েছে। টুলটির বেশকিছু ডিটেকশন মেথডের মধ্যে সিংহভাগ মেথডেই ভিডিওটি অধিকতর সম্ভাব্য এআই দ্বারা তৈরি বলে ফলাফল পাওয়া গেছে। দেখুন--

অর্থাৎ ভিডিওটি এআই প্রযুক্তিতে তৈরি।

সুতরাং সামাজিক মাধ্যমে এআই প্রযুক্তিতে তৈরি একটি ভিডিওকে বাস্তবে দেওয়া বক্তব্যের বলে প্রচার করা হচ্ছে; যা বিভ্রান্তিকর।